Review sản phẩm

Mọi thứ bạn cần biết về người khổng lồ AI Trung Quốc

Có liên quan

Gemini Advanced: Mọi thứ bạn cần biết về AI cao cấp của Google

AI cao cấp của Google đã giải thích

Deepseek là gì?

Hãy bắt đầu với những điều cơ bản

Nguồn: TV.cctv.com

Deepseek là một công ty AI của Trung Quốc được thành lập bởi Liang Wen Phường, đồng sáng lập của một công ty quỹ phòng hộ định lượng thành công sử dụng AI để thông báo các quyết định đầu tư của mình. Năm 2023, Liang bắt đầu Deepseek như một dự án phụ để theo đuổi trí thông minh chung nhân tạo, nhưng điều này còn hơn cả việc gây ra một triệu phú lập dị.

Liang bắt đầu xây dựng trung tâm dữ liệu của riêng mình vào năm 2015 với 100 card đồ họa. Ông đã mở Fire-Flyer 1 vào năm 2019 với 1.100 thẻ và khoản đầu tư 30 triệu đô la. Sau khi giảm 140 triệu đô la, anh đã ra mắt Fire-Flyer 2 vào năm 2021 bằng cách sử dụng 10.000 card đồ họa NVIDIA A100 (40GB, 80GB, ≥1TB/s, ~ 10.000 đô la/đơn vị). Sau đó, anh quyết định nghiêm túc về hoạt động kinh doanh AI này và tạo ra Deepseek.

Deepseek đã làm gì trước năm 2025?

Liang không lãng phí thời gian. Chưa đầy sáu tháng sau khi Deepseek là một điều, nó đã phát hành DeepSeek Coder và Deepseek-Llm vào tháng 11 năm 2023. .

Vào tháng 5 năm ngoái, thế giới đã chứng kiến công ty Trung Quốc yên tĩnh này có thể gây rối như thế nào. Deepseek đã phát hành mô hình V2 của mình với các mã thông báo có giá thấp đến mức nó đã gây ra một cuộc chiến giá cả ở Trung Quốc, buộc các công ty như Alibaba, Bytedance và Tencent phải giảm giá để theo kịp. Vào ngày sau Giáng sinh 2024, bảy tháng sau khi phát hành V2, Deepseek đã phát hành V3. Đó là nơi câu chuyện của Deepseek trong chu kỳ tin tức hiện tại bắt đầu.

Có liên quan

Chatgpt là gì?

Tìm hiểu Chatgpt là gì, nó hoạt động như thế nào, bạn có thể làm gì với nó và chi phí bao nhiêu để sử dụng Chatbot AI tiên tiến nhất của Openai

Deepseek-V3 và Deepseek-R1 là gì?

Và tại sao họ lại làm rung chuyển ngành công nghiệp rất nhiều?

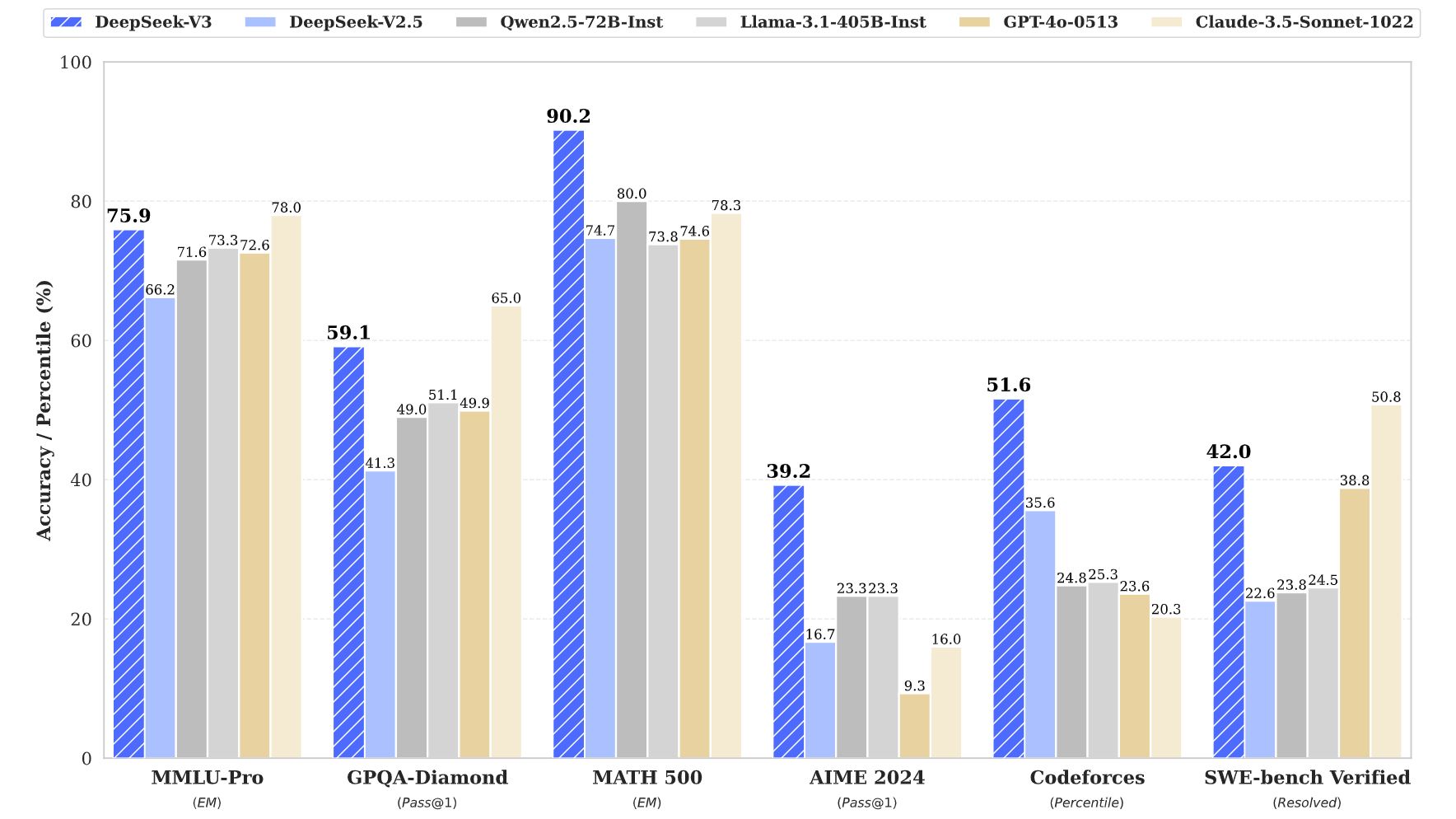

Deepseek-V3 là một mô hình ngôn ngữ lớn, đa năng, hoạt động tốt hơn một chút so với GPT-4O và các LLM hàng đầu khác trên hầu hết các điểm chuẩn. V3 tốt hơn một chút so với 4o (có một số thủ thuật gọn gàng V3 không) dường như không phải là tin tức lớn, khi xem xét ngành công nghiệp AI đã tham gia một cuộc chạy đua vũ trang kể từ khi OpenAI's GPT-3 xuất hiện vào năm 2020. Đó là điều kiện mà theo đó V3 vượt trội hơn 4o đáng chú ý.

Đầu tiên, mặc dù V3 đã được đào tạo với 671 tỷ thông số, DeepSeek tuyên bố chi phí đào tạo mô hình này là khoảng 6 triệu đô la (dựa trên 2,788 triệu giờ đào tạo trên GPU H800 ở mức 2 đô la mỗi giờ GPU, là về tỷ lệ thị trường). Giám đốc điều hành Openai Sam Altman đã từng châm biếm GPT-4 (tiền thân của GPT-4O) có giá hơn 100 triệu đô la. Sự khác biệt trong chi phí đào tạo cho hai mô hình được cung cấp năng lượng tương tự đến mức nó đã làm rung chuyển thị trường.

Nguồn: Deepseek/GitHub

Hơn nữa, V3 sử dụng kiến trúc hỗn hợp của các chuyên gia, có nghĩa là nó không kích hoạt tất cả các tham số 671 tỷ cho mỗi truy vấn. Nó chỉ sử dụng khoảng 37 tỷ trong số họ. Điều đó tương đương với các phản hồi nhanh hơn và chi phí tính toán thấp hơn cho mỗi truy vấn, cho phép Deepseek tính ít hơn cho các mã thông báo của nó. OpenAI tính phí 2,50 đô la một triệu mã thông báo đầu vào và mã thông báo đầu ra 10 mỗi triệu đô la trên mô hình GPT-4O của nó. Deepseek tính phí mã thông báo đầu vào 0,14 đô la trên một triệu đô la và mã thông báo đầu ra 0,28 đô la trên một triệu trên các mã thông báo. Sự khác biệt về giá là đáng kinh ngạc.

|

Giá mỗi triệu mã thông báo |

Đầu vào |

Đầu ra |

|---|---|---|

|

Deepseek-V3 |

$ 0,14 |

$ 0,28 |

|

GPT-4O |

$ 2,50 |

$ 10,00 |

Tại sao Deepseek-R1 là một vấn đề lớn?

Mô hình R1 của Deepseek được xây dựng ở mặt sau của mô hình V3 trước đó và chuyên về lý luận, một loại độc thoại nội bộ cho LLM (còn được gọi là chuỗi tư tưởng). Điều làm cho R1 trở nên thú vị là ban đầu nó được sản xuất độc quyền bằng cách sử dụng việc học củng cố mà không có việc học có giám sát.

Học tập được giám sát là một kỹ thuật học máy dạy mô hình bằng cách sử dụng các cặp đầu vào và đầu ra được dán nhãn. Tăng cường học tập các nhãn Eschews và thưởng cho mô hình khi nó gần hơn với các đầu ra mong muốn.

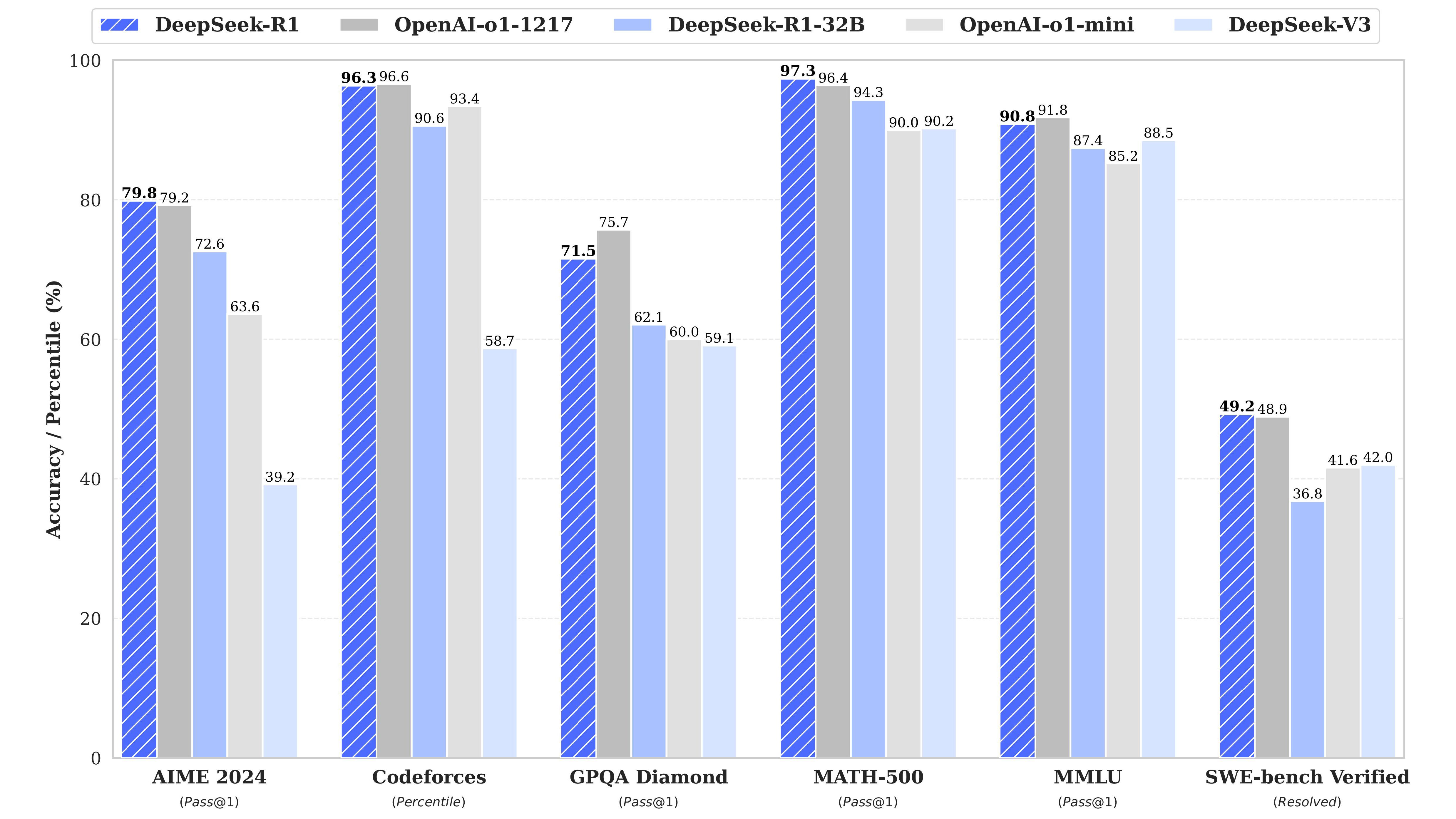

Nguồn: Deepseek/GitHub

Mô hình ban đầu được làm từ kỹ thuật chỉ có gia cố này là R1-Zero và nó đã phát triển khả năng lý luận mới nổi. Nó không cần phải được đào tạo để có một độc thoại nội bộ. Nó chỉ xảy ra. Vấn đề với R1-Zero là nó không thể hiểu được lắm mặc dù điểm chuẩn cao. Deepseek đã giải quyết vấn đề này bằng cách điều chỉnh mô hình với việc học có giám sát hạn chế, dẫn đến R1, có thể phù hợp với mô hình lý luận O1 của Openai trên nhiều điểm chuẩn trong khi giảm giá của Openai.

|

Giá mỗi triệu mã thông báo |

Đầu vào |

Đầu ra |

|---|---|---|

|

Deepseek-R1 |

$ 0,14, $ 0,55 |

$ 2,19 |

|

Openai-O1 |

$ 7,50 $ 15,00 |

$ 60,00 |

Deepseek không phải là kết thúc của Openai (hoặc Llama, hoặc Song Tử, hoặc nhân học)

Cuộc đua vũ trang AI chỉ mới bắt đầu

Hậu quả thị trường của DeepSeek phát hành R1 không được cảm nhận trong vài ngày, nhưng khi nó phản ứng, thị trường đã phản ứng to lớn. Chỉ số Nasdaq chứng kiến sự mất 1 nghìn tỷ đô la vốn hóa thị trường. Nvidia đã có nó tồi tệ hơn bất cứ ai, mất gần 600 tỷ đô la. Làm thế nào Deepseek có thể kích hoạt loại phản ứng này?

Có liên quan

7 giải pháp thay thế tốt nhất

Hãy thử các công cụ AI này khi Chatgpt bị hỏng

Deepseek phù hợp với tốt nhất mà Openai đã phát hành, sử dụng phần cứng rẻ hơn (như những chiếc điện thoại ngân sách tuyệt vời này) cho thời gian đào tạo ít hơn, đặt câu hỏi về sự cần thiết cho các trung tâm dữ liệu lớn và GPU đắt tiền. Rốt cuộc, tại sao đầu tư 100 triệu đô la vào đào tạo một mô hình mới với phần cứng đắt tiền khi 6 triệu đô la và silicon rẻ hơn cũng tốt như vậy? Các mô hình của Deepseek sẽ không thay thế gã khổng lồ AI của Mỹ cũng như không cần phải có nhu cầu về bộ xử lý nâng cao. Các thị trường đã gần như phục hồi sau vụ tai nạn tháng trước, cho thấy ngành công nghiệp AI đang nhanh chóng trở lại kinh doanh như bình thường.

Nhưng đừng nghĩ rằng đã không có sự thay đổi trên biển. Các mô hình mới của Deepseek đã chứng minh rằng sự thay đổi có thể đến từ những người chơi nhỏ hơn khám phá các kỹ thuật mới. Bởi vì Deepseek Open có nguồn gốc cách nó tạo ra các mô hình của nó, mọi người đều tự do sao chép các phương pháp của nó để làm cho các mô hình của họ tốt hơn.

Điều đó đã xảy ra. Một nhóm từ Berkeley đã áp dụng thuật toán học củng cố của Deepseek để đào tạo mô hình Qwen 3B để giải các câu đố toán đơn giản. Đối với 30 đô la thời gian xử lý, lý do suy nghĩ tương tự có trong mô hình R1-Zero đã xuất hiện trong mô hình chuyên dụng của họ, cho thấy lý luận mới nổi được báo cáo bởi Deepseek không chỉ là một sự tự hào trống rỗng. Nói cách khác, hãy tìm kiếm nhiều người chơi lớn hơn để sử dụng các kỹ thuật đào tạo này được DeepSeek tiên phong và được phát hành ra công chúng.

Cuộc đua vũ trang AI đang nóng lên

Thay vì đánh cắp sấm sét của các công ty AI lớn, Deepseek đã tiêm gió mới vào các cánh buồm của ngành công nghiệp. Nhiều hơn là chứng minh rằng sự đổi mới có thể đến từ những người chơi nhỏ hơn và phần cứng cũ hơn, nó cho thấy các đối thủ cạnh tranh được tài trợ tốt hơn (như Gemini và TATGPT) có khả năng đưa ra những thủ thuật mới này. Năm ngoái là một năm nóng bỏng đối với AI, nhưng đừng mong đợi năm 2025 sẽ hạ nhiệt.

Khám phá thêm từ Phụ Kiện Đỉnh

Đăng ký để nhận các bài đăng mới nhất được gửi đến email của bạn.